Avez-vous déjà remarqué comme, dans le métro, dans la rue ou à une soirée, les visages se ressemblent ? Pas physiquement, mais dans leur posture : les yeux rivés sur un écran, le pouce qui scrolle sans fin, absorbé par un flux qui ne s’arrête jamais. Ce flux, c’est celui des réseaux sociaux. Et s’il donne l’illusion d’un monde ouvert, il nous enferme souvent dans une bulle invisible : la bulle algorithmique.

Une bulle confortable, faite de contenus qui nous plaisent, qui confirment ce qu’on pense déjà, qui nous ressemblent un peu trop. Ce n’est pas un hasard : les plateformes sont conçues pour ça. Pour nous garder connectés le plus longtemps possible. Scroll après scroll, nos goûts, nos clics, nos opinions nourrissent un algorithme qui façonne une version personnalisée du monde, la nôtre.

Résultat : chacun vit dans une réalité légèrement différente, calibrée par ses propres habitudes numériques. Dans cet article, on vous explique comment ces bulles se forment, pourquoi elles influencent nos comportements (souvent à notre insu), et surtout, comment en sortir sans forcément se déconnecter.

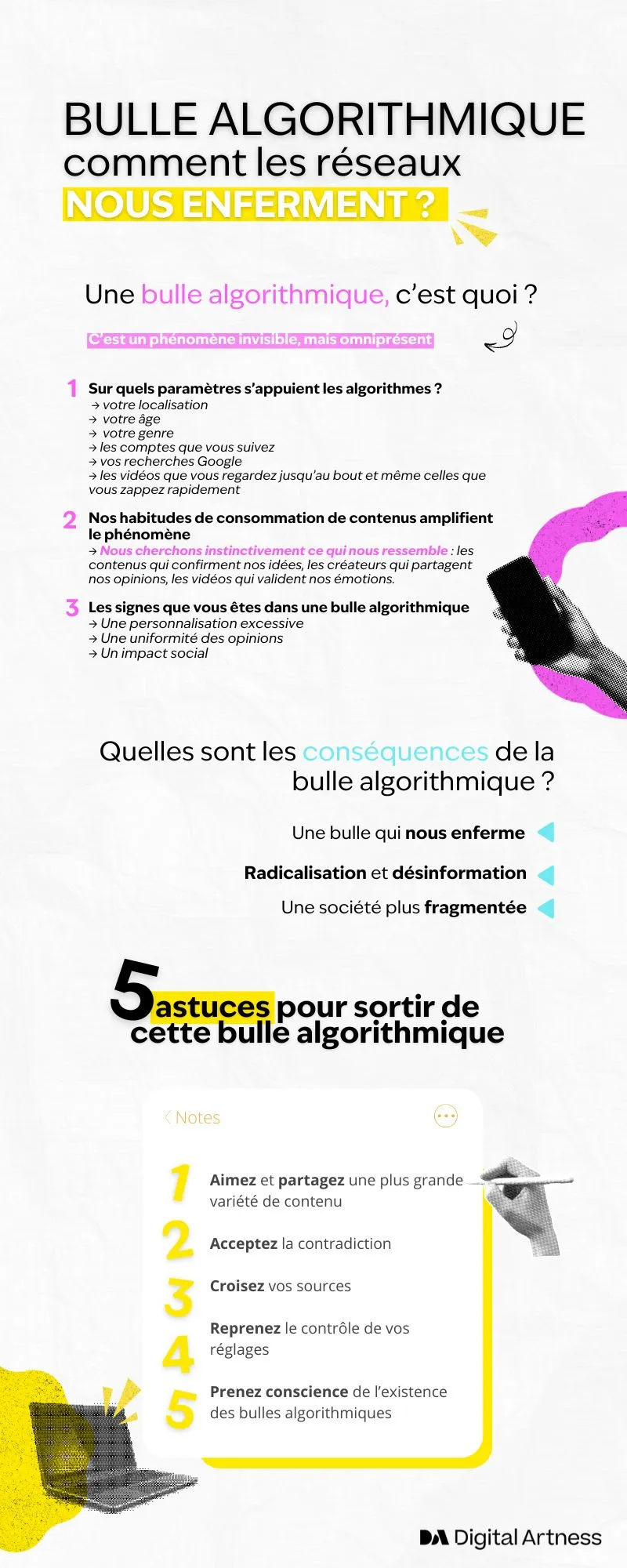

Une bulle algorithmique, c’est quoi ?

C’est un phénomène invisible, mais omniprésent. Chaque jour, les algorithmes, ceux des réseaux sociaux, des moteurs de recherche ou même de nos plateformes de streaming, filtrent les informations que nous voyons.

Leur mission ?

Nous proposer des contenus qui collent parfaitement à nos goûts, nos opinions, nos comportements.

En théorie, c’est pratique : tout ce qu’on aime est à portée de clic. En pratique, c’est plus plus problématique qu’on ne le pense.

À force de nous montrer ce qu’on approuve déjà, l’algorithme finit par enfermer chacun de nous dans une bulle : une version personnalisée du monde, taillée sur mesure pour nos préférences.

1. Sur quels paramètres s’appuient les algorithmes ?

Les algorithmes sont constamment mis à jour et s’améliorent chaque jour pour proposer un contenu toujours plus ciblé. Chaque scroll, chaque like, chaque recherche alimente leur apprentissage.

Ils analysent tout : votre localisation, votre âge, votre genre, les comptes que vous suivez, vos recherches Google, les vidéos que vous regardez jusqu’au bout et même celles que vous zappez rapidement. Grâce à toutes ces données, les plateformes construisent un profil ultra-précis : vos goûts, vos opinions, vos émotions numériques.

Le résultat, c’est un fil d’actualité qui semble parfaitement adapté à vous mais qui finit par ne plus montrer que ce que vous voulez voir. Autrement dit, l’algorithme ne reflète pas la réalité : il reflète votre propre version de la réalité. Et plus il vous connaît, plus il vous enferme dans cette version.

2. Nos habitudes de consommation de contenus amplifient le phénomène

Le paradoxe, c’est que nous aimons ça. Nous cherchons instinctivement ce qui nous ressemble : les contenus qui confirment nos idées, les créateurs qui partagent nos opinions, les vidéos qui valident nos émotions. Cette proximité crée une sensation de confort : tout paraît logique, familier, rassurant.

Mais elle renforce aussi le fonctionnement des algorithmes, qui se disent : “Parfait ! Tu veux du contenu comme ça ? Je vais t’en donner encore plus.” Ce mécanisme n’est pas qu’éditorial : il est aussi économique. Plus nous restons sur une plateforme, plus elle nous montre de publicités ciblées, et plus elle gagne d’argent. Le contenu personnalisé n’est donc pas seulement un service, c’est un business model.

3. Les signes que vous êtes dans une bulle algorithmique

La bulle algorithmique se manifeste de plusieurs façons, souvent discrètes, mais révélatrices :

→ Une personnalisation excessive : les contenus manquent de diversité et se ressemblent tous.

→ Une uniformité des opinions : vous ne voyez plus que des gens qui pensent comme vous.

→ Un impact social : il devient difficile d’écouter d’autres points de vue ou de communiquer avec ceux qui ne partagent pas nos idées.

Et c’est à ce moment-là que la bulle devient problématique.

Parce qu’au lieu de nous ouvrir au monde, elle nous en éloigne tout en nous donnant l’illusion d’y être plus connectés que jamais.

Quelles sont les conséquences de la bulle algorithmique ?

À première vue, la bulle algorithmique semble inoffensive. Après tout, quoi de plus agréable que de voir des contenus qu’on aime ? Mais à force de nous montrer uniquement ce qui nous ressemble, elle finit par nous isoler intellectuellement et parfois même, nous opposer les uns aux autres.

1. Une bulle qui nous enferme

Plus la bulle se resserre, plus notre monde vision du monde se réduit. Les contenus qui nous contredisent disparaissent du fil d’actualité. Ceux qui nous confortent sont valorisés, mis en avant, likés, commentés, amplifiés. C’est ce qu’on appelle le biais de confirmation : cette tendance à privilégier ce qui va dans notre sens, quitte à ignorer le reste.

Les algorithmes n’ont pas inventé ce biais, mais ils le renforcent à chaque scroll. Résultat : on finit par confondre ce qu’on voit avec ce qui est vrai. On croit que tout le monde partage notre opinion, simplement parce que c’est tout ce que l’on voit. Et quand un contenu vient la contredire, il nous dérange, voire nous agace.

Petit à petit, on perd l’habitude d’écouter, de douter, de débattre. C’est ainsi que la bulle algorithmique, confortable au départ, devient une forme d’isolement cognitif.

2. Radicalisation et désinformation

Cette personnalisation extrême ne fait pas que réduire la diversité des idées : elle ouvre la porte à la désinformation. Prenons un exemple concret. Sur YouTube ou TikTok, il suffit de regarder une vidéo complotiste pour que la plateforme vous en suggère dix autres du même genre.

Le contenu devient plus radical, plus émotionnel, plus clivant parce que ce type de contenu génère plus d’engagement. C’est ce qu’on appelle un effet de spirale : plus on s’enfonce dans un sujet, plus l’algorithme nous y enferme.

Le documentaire “MASCUS” sur YouTube illustre bien ce phénomène : des communautés entières se forment autour d’idées extrêmes, sans confrontation avec le réel. Ce mécanisme touche particulièrement les plus jeunes, dont l’esprit critique est encore en construction. À force de n’être exposés qu’à une seule vision du monde, ils finissent par la confondre avec la réalité elle-même.

3. Une société plus fragmentée

Au-delà du simple usage individuel, cette logique de bulle a un impact collectif. Elle alimente les divisions, les incompréhensions et les tensions sociales.

Quand chacun vit dans un univers informationnel différent, le dialogue devient impossible. On ne parle plus le même langage, on ne partage plus les mêmes repères, et le débat d’idées laisse place à la confrontation d’opinions.

Les bulles algorithmiques ne créent pas les fractures sociales mais elles les amplifient. Elles transforment nos fils d’actualité en miroirs déformants, où le monde n’est plus qu’une projection de nous-mêmes.

5 astuces pour sortir de cette bulle algorithmique

Bonne nouvelle : il est tout à fait possible d’en sortir ! Les bulles algorithmiques ne sont pas des prisons numériques, mais des espaces qu’on peut élargir, à condition de le faire consciemment.

L’objectif ? Contrebalancer les points de vue auxquels on est exposé et retrouver un fil d’actualité plus ouvert et plus nuancé.

1. Aimez et partagez une plus grande variété de contenu

C’est la première étape et la plus simple : soyez curieux ! Likez, commentez et partagez des publications qui sortent de vos habitudes. Explorez de nouveaux sujets, de nouvelles cultures, de nouvelles voix.

L’algorithme ne fait qu’apprendre de vous : plus vous lui montrez que vos centres d’intérêt sont variés, plus il diversifie ce qu’il vous propose.

2. Acceptez la contradiction

Acceptez de ne pas toujours être d’accord. Suivre des comptes ou des médias qui défendent des idées différentes, c’est une façon saine de garder l’esprit ouvert.

Abonnez-vous à des profils que vous n’auriez jamais suivis, lisez des commentaires contraires aux vôtres, sortez de votre zone de confort intellectuel. C’est parfois inconfortable, mais toujours enrichissant. Ces petites actions permettent à l’algorithme de vous exposer à des points de vue opposés et donc, à recréer du débat plutôt que du simple écho.

3. Croisez vos sources

Ne laissez pas une seule plateforme ou un seul média construire votre vision du monde. Lisez, regardez, écoutez plusieurs sources avant de vous faire une opinion.

Passez d’un média traditionnel à un créateur indépendant, d’un article à un podcast, d’un fil X (Twitter) à une vidéo YouTube. Ce mélange est le meilleur antidote contre la désinformation et la pensée unique.

4. Reprenez le contrôle de vos réglages

Les plateformes aiment décider à votre place, mais rien ne vous empêche de reprendre la main.

Sur Facebook, Instagram , Linkedin ou X (Twitter), changez le tri de votre fil d’actualité en mode “plus récents” au lieu de “contenus suggérés”. Désactivez les notifications inutiles.

Et n’hésitez pas à “masquer” les contenus qui tournent toujours en boucle.

Plus vous contrôlez votre feed, moins il vous contrôle.

5. Prenez conscience de l’existence des bulles algorithmiques

Les bulles algorithmiques existent, et elles ne vont pas disparaitre.

Mais les comprendre, c’est déjà s’en libérer un peu. Il est essentiel d’en parler et de sensibiliser votre entourage à ce sujet, surtout les plus jeunes, de plus en plus exposés à internet et aux réseaux sociaux.

Conclusion – Reprendre le contrôle de son fil d’actualité sur les réseaux sociaux

Les bulles algorithmiques ne sont pas des ennemies !

Elles reflètent nos goûts, nos curiosités, nos certitudes mais aussi nos angles morts. Et à force de ne voir que ce qu’on aime, on finit par oublier ce qu’on ne connaît plus.

L’enjeu n’est donc pas de quitter les réseaux sociaux, mais d’y naviguer autrement, avec conscience.

De comprendre que chaque like est un choix et que notre fil d’actualité est bien plus façonné par nous que nous le pensons.

Sortir de sa bulle, c’est accepter d’être surpris, parfois bousculé, souvent inspiré. C’est redonner de la place au doute, à la nuance et à la diversité d’opinions.

Chez Digital Artness, c’est exactement ce qu’on aime faire : aider les marques (et les humains derrière elles) à reprendre le contrôle de leur regard numérique et à rajouter plus de sens dans leurs contenus.